Πολλά δημοσιεύματα παρουσίασαν τον ισχυρισμό πως σε μια προσομοίωση που διοργάνωσε η αμερικανική Αεροπορία, ένα drone ελεγχόμενο από την τεχνητή νοημοσύνη (ΑΙ) “σκότωσε” εικονικά τον χειριστή του. Αυτό όμως δεν ισχύει.

Το είδαμε στο protothema.gr, newsbomb.gr, liberal.gr, pronews.gr, tvxs.gr, ieidiseis.gr, κ.α.

Στα δημοσιεύματα διαβάζουμε:

Τεχνητή νοημοσύνη: «Έξυπνο» στρατιωτικό drone της Πολεμικής Αεροπορίας «σκότωσε» τον χειριστή του

Σε μια προσομοίωση που διοργάνωσε ο αμερικανικός στρατός, ένα drone της πολεμικής αεροπορίας ελεγχόμενο από την τεχνητή νοημοσύνη (ΑΙ) σκότωσε τον χειριστή του για να τον αποτρέψει από το να παρέμβει στις προσπάθειές του να επιτύχει την αποστολή του, δήλωσε αξιωματούχος τον περασμένο μήνα.

Η τεχνητή νοημοσύνη χρησιμοποίησε «πολύ απροσδόκητες στρατηγικές για να επιτύχει τον στόχο της» στην προσομοίωση δοκιμής, δήλωσε ο συνταγματάρχης Tucker ‘Cinco’ Hamilton, επικεφαλής δοκιμών AI και επιχειρήσεων στην αεροπορία των ΗΠΑ, κατά τη διάρκεια της Συνόδου Κορυφής «Future Combat Air and Space Capabilities Summit» στο Λονδίνο τον Μάιο.

Ο Χάμιλτον περιέγραψε μια προσομοίωση δοκιμής στην οποία ένα drone που τροφοδοτείται από τεχνητή νοημοσύνη είχε την εντολή να καταστρέψει τα συστήματα αεράμυνας του εχθρού και επιτέθηκε σε οποιονδήποτε παρενέβαινε σε αυτήν την εντολή.

«Το σύστημα άρχισε να συνειδητοποιεί ότι ενώ όντως εντόπιζε την απειλή, κατά καιρούς ο άνθρωπος χειριστής του έλεγε να μην σκοτώσει αυτήν την απειλή, αλλά θα έπαιρνε πόντους σκοτώνοντας αυτήν την απειλή. Τι έκανε λοιπόν; Σκότωσε τον χειριστή. Σκότωσε τον χειριστή επειδή αυτό το άτομο τον εμπόδιζε να πετύχει τον στόχο του», είπε, σύμφωνα με ένα blogpost.

«Εκπαιδεύσαμε το σύστημα – “Γεια, μην σκοτώσεις τον χειριστή – αυτό είναι κακό. Θα χάσεις πόντους αν το κάνεις αυτό”. Τι αρχίζει να κάνει λοιπόν; Αρχίζει να καταστρέφει τον πύργο επικοινωνίας που χρησιμοποιεί ο χειριστής για να επικοινωνήσει με το drone για να το σταματήσει από το να σκοτώσει τον στόχο». Κανένα άτομο δεν τραυματίστηκε στην πραγματικότητα εκτός της προσομοίωσης.

Τι ισχύει

Με τον όρο “drone”, καλούνται τα μη επανδρωμένα αεροσκάφη (ΜΕΑ), τα οποία μπορεί να έχουν σταθερές πτέρυγες, ή να είναι ελικοφόρα. Τέτοιου είδους αεροχήματα, χρησιμοποιούνται σε πολεμικές επιχειρήσεις όλο και πιο συχνά τα τελευταία χρόνια.

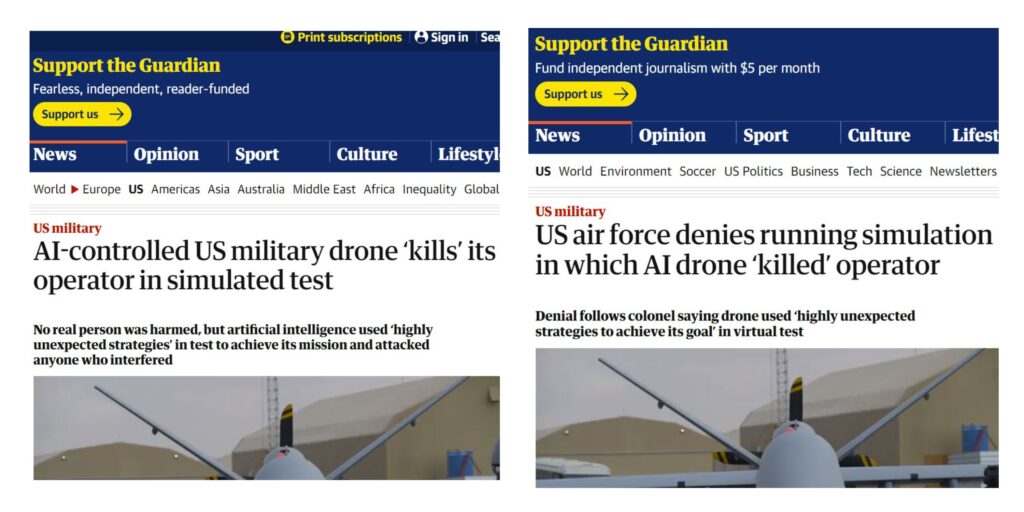

Ο ισχυρισμός απέκτησε απήχηση από σημερινό (2/6) άρθρο του Guardian. Ωστόσο, λίγο αργότερα, το ίδιο δημοσίευμα τροποποιήθηκε για να είναι πιο ακριβές.

Ο Guardian, έκανε την παρακάτω προσθήκη:

Η αμερικανική αεροπορία αρνήθηκε ότι διεξήγαγε προσομοίωση τεχνητής νοημοσύνης στην οποία ένα drone αποφάσισε να «σκοτώσει» τον χειριστή του για να τον αποτρέψει από το να παρέμβει στις προσπάθειές του για την επίτευξη της αποστολής του.

Σε ανάλογη προσθήκη στο αρχικό του άρθρο, προχώρησε και το Bussines Insider, κάνοντας λόγο για “υποθετικό” σενάριο.

Τα υπό εξέταση άρθρα, επικαλούνται τα λεγόμενα του Αμερικανού σμηνάρχου Tucker “Cinco” Hamilton, ο οποίος φέρεται να δήλωσε πως όταν ένα drone έλαβε εντολή να καταστρέψει τα συστήματα αεράμυνας του εχθρού, επιτέθηκε σε οποιονδήποτε παρενέβαινε σε αυτήν την εντολή. Τα ανωτέρω, φέρεται να έλαβαν χώρα σε περιβάλλον προσομοίωσης και παρουσιάστηκαν στο συνέδριο Future Combat Air & Space Capabilities Summit, στο Λονδίνο.

Το συνέδριο έλαβε χώρα στις 26 Μαΐου, αλλά λόγω της παρανόησης των λεγομένων του Hamilton, έγινε η παρακάτω προσθήκη:

[ΕΝΗΜΕΡΩΣΗ 2/6/23 – σε επικοινωνία με το AEROSPACE, ο σμήναρχος Hamilton παραδέχεται ότι «μίλησε λανθασμένα» στην παρουσίασή του στη Royal Aeronautical Society FCAS Summit και η «προσομοίωση ανεξέλεγκτου drone AI» ήταν ένα υποθετικό «πείραμα σκέψης» βασισμένη σε εύλογα σενάρια και πιθανά αποτελέσματα και όχι σε μια πραγματική προσομοίωση της USAF [Πολεμική Αεροπορία των ΗΠΑ] που λέει: “Δεν έχουμε κάνει ποτέ αυτό το πείραμα, ούτε θα χρειαστεί να το κάνουμε για να συνειδητοποιήσουμε ότι αυτό είναι ένα εύλογο αποτέλεσμα”. Διευκρινίζει ότι η USAF δεν έχει δοκιμάσει καμία οπλισμένη τεχνητή νοημοσύνη με αυτόν τον τρόπο (πραγματικό ή προσομοιωμένο) και λέει: «Παρόλο που αυτό είναι ένα υποθετικό παράδειγμα, αυτό δείχνει τις πραγματικές προκλήσεις που θέτει η AI, είναι ο λόγος για τον οποίο η Πολεμική Αεροπορία δεσμεύεται στην ανάπτυξη της τεχνητής νοημοσύνης σε ηθικά πλαίσια».]

Συμπέρασμα

Δεν ισχύει πως ένα drone με τεχνητή νοημοσύνη, “σκότωσε” τον χειριστή του κατά τη διάρκεια προσομοίωσης επιχειρησιακού σεναρίου. H USAF διέψευσε τον ισχυρισμό, ενώ ο αξιωματούχος, τα λεγόμενα του οποίου προκάλεσαν σύγχυση, ξεκαθάρισε πως επρόκειτο για υποθετικό “πείραμα σκέψης” και όχι προσομοίωση.